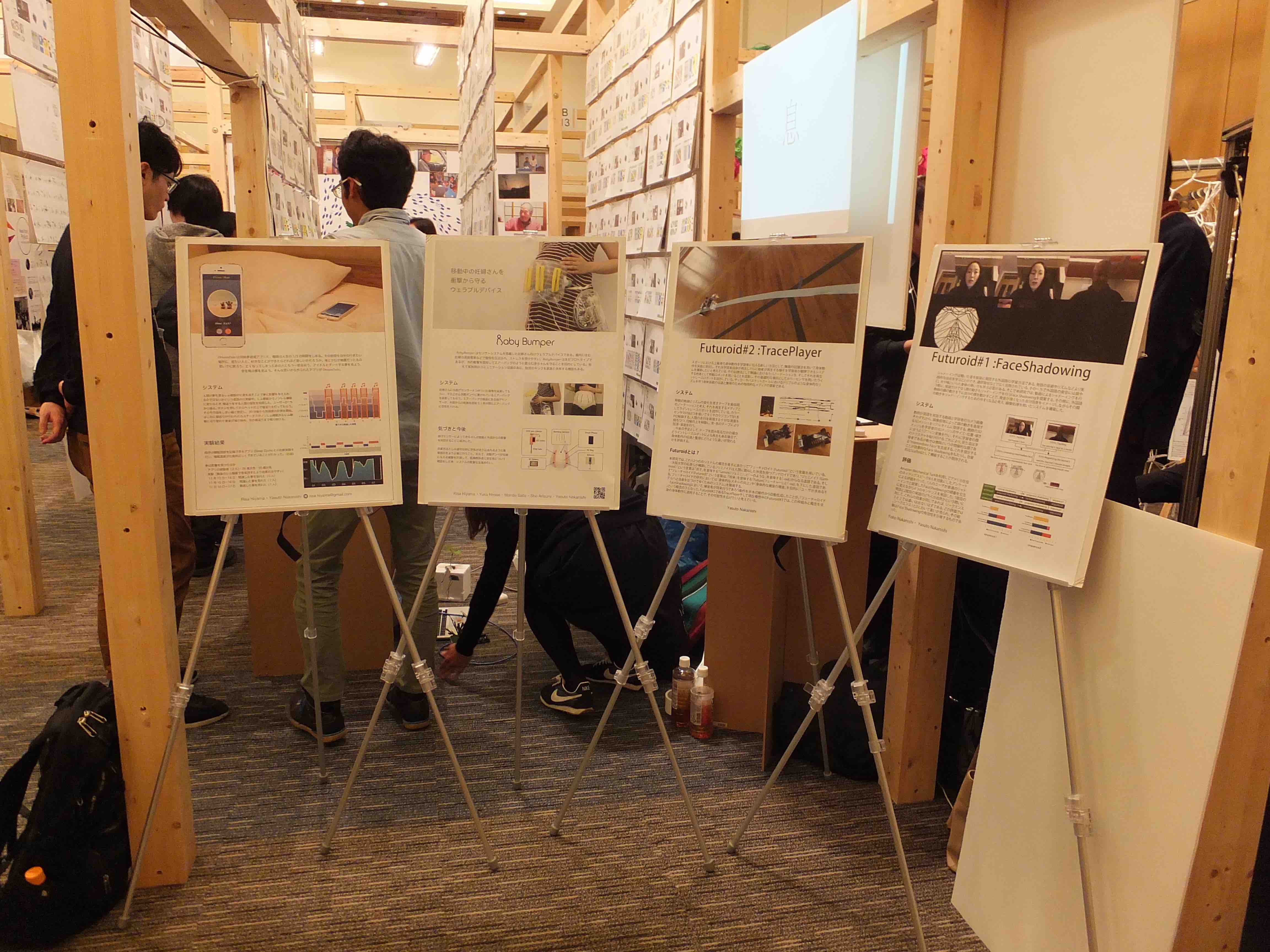

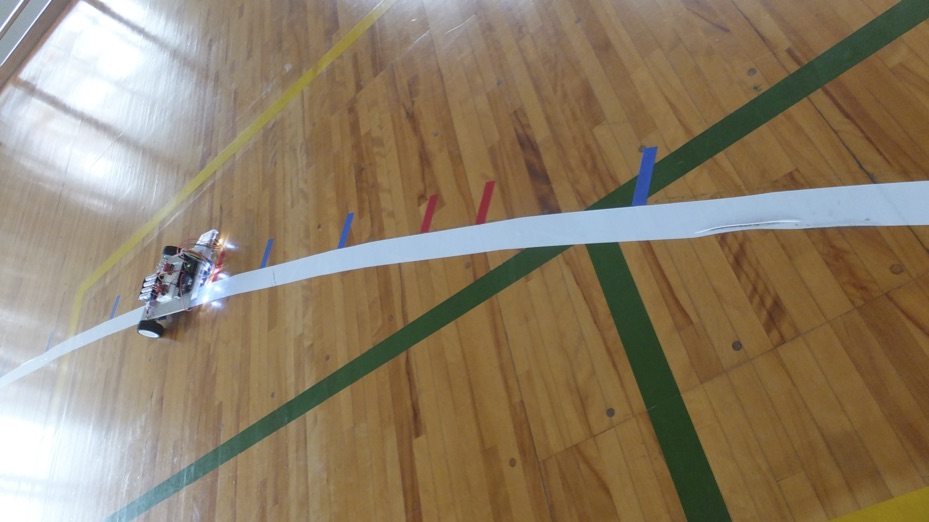

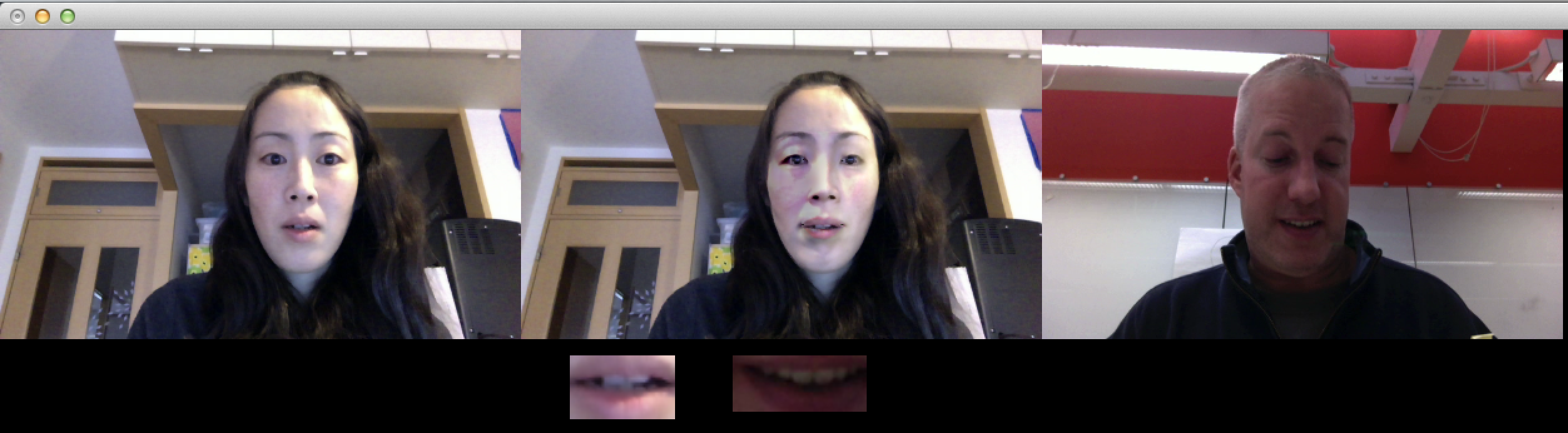

12月に二つのハッカソン・ワークショップのお手伝いをしました。

ひとつ目は、研究室OBである竹中工務店の粕谷貴司君が主催しているスマートライフハッカソン です。

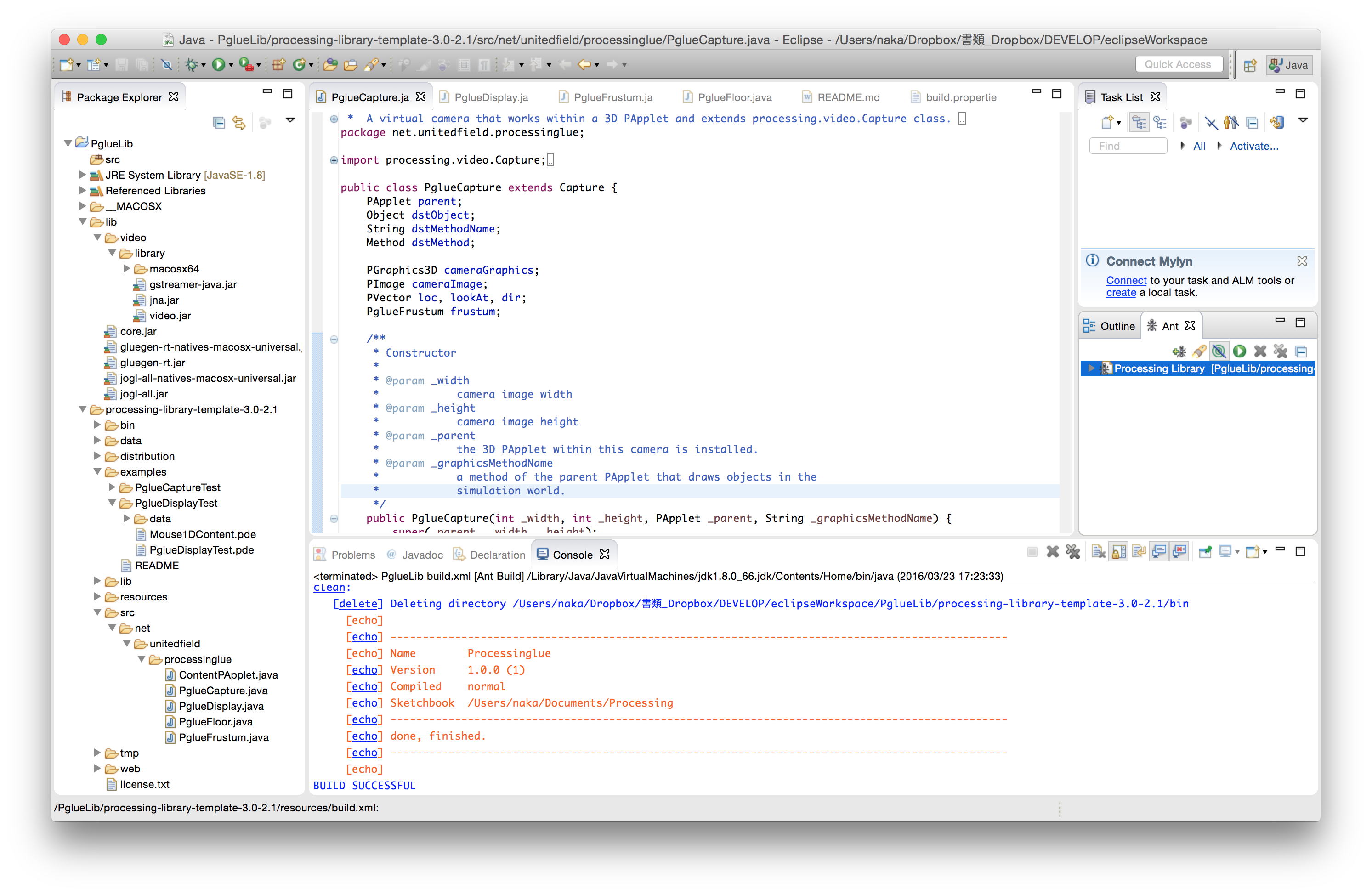

ふたつ目は、LA在住のコンピューテーショナル・デザイナー杉原聡さんが開発したProcessingと建築用ライブラリiGeoのワークショップです。Processing:ビジュアルデザイナーとアーティストのためのプログラミング入門 Morphosis で実務を経験し、コンピューテーショナルデザインによってさまざまなビルのファサードを実作されている先端的な建築家です(現在はご自身の設計事務所ATLV を主宰)。

VIDEO

そして、ご自身がファサードのデザインを実践するために作ったライブラリを惜しげもなくオープンソースで公開しているのがiGeoです。iGeo ]iGeoのワークショップを初めて日本で開催 しました。ワークショップには建築の実務に携わっている方、建築を学んでいる学生、グラフィックデザインやプロダクトデザインの実務に関わっている方など30名ほどの方が参加されました。開催場所はグローバルに活動されているデザインコンサルティングファームziba tokyo のオフィスのオープンスペースを提供していただきました。

中西は運営の手伝いをしながら、iGeoを使ってエージェントベースのコンピューテーショナルデザインを実際にプログラミングしました。エージェントを使った形態生成では、自分でアルゴリズムを組んで形態を生成する以上に、自分の想像を超えたモノが立ち現れます。自分が制御できる部分と自分では制御できない部分のせめぎ合いを楽しみながら、自分のコントロールを捨て去ったところに新しい形態が現象する感覚を味わうことができました。

アメリカやヨーロッパの大学では開催されていましたが、このタイミングに合わせてドキュメントも日本語化されました。多くのユーザの方にiGeoを使ったコンピューテーショナルデザインを体験してもらいたいと思います。iGeo 日本語チュートリアル ]

スマートライフハッカソンならびにiGeoワークショップに参加いただいた皆さん、場所を提供いただいたziba tokyoの皆さま、どうもありがとうございました!